ATOM Report:中国开源模型已经全面领先,而且差距还在扩大

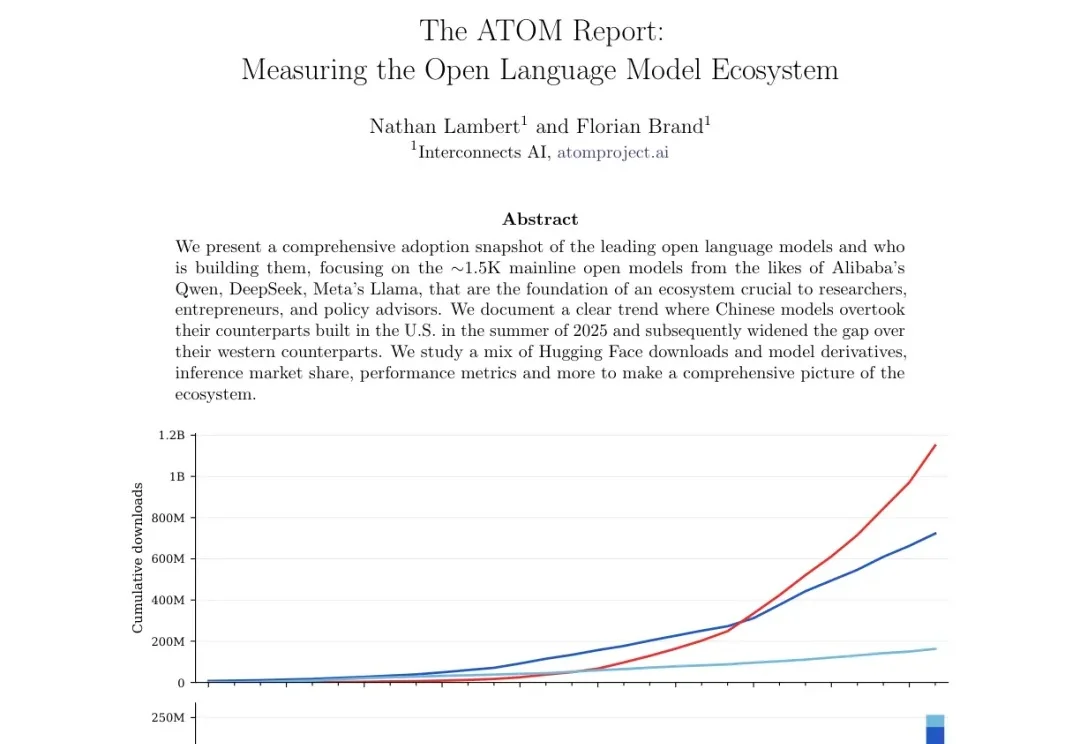

ATOM Report:中国开源模型已经全面领先,而且差距还在扩大2026 年 4 月,Nathan Lambert 和 Florian Brand 发布了 The ATOM Report,一份关于开源语言模型生态的综合采纳度快照。这份报告追踪了约 1500 个主线开源模型的下载量、衍生模型、推理市场份额和性能数据,覆盖 2023 年 11 月到 2026 年 3 月

搜索

搜索

2026 年 4 月,Nathan Lambert 和 Florian Brand 发布了 The ATOM Report,一份关于开源语言模型生态的综合采纳度快照。这份报告追踪了约 1500 个主线开源模型的下载量、衍生模型、推理市场份额和性能数据,覆盖 2023 年 11 月到 2026 年 3 月

Thinking Machines Lab发布首个产品:Thinker,让模型微调变得像改Python代码一样简单。也算是终于摘掉了“0产品0收入估值840亿”的帽子。Tinker受到了业界的密切关注。AI基础设施公司Anyscale的CEO Robert Nishihara等beta测试者表示,尽管市面上有其他微调工具,但Tinker在“抽象化和可调性之间取得了卓越的平衡”

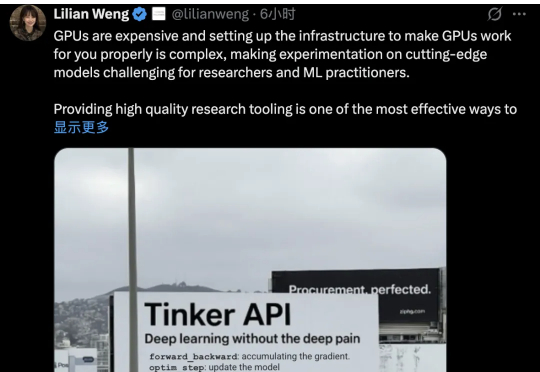

最近,Mamba 作者之一 Albert Gu 又发新研究,他参与的一篇论文《 Dynamic Chunking for End-to-End Hierarchical Sequence Modeling 》提出了一个分层网络 H-Net,其用模型内部的动态分块过程取代 tokenization,从而自动发现和操作有意义的数据单元。

“Grok”一词不是马斯克原创,而是源于科幻作家罗伯特·海因莱因 (Robert A. Heinlein) 1961年的经典小说《异乡异客》(Stranger in a Strange Land)。在小说中,“Grok”是一个火星词汇,其含义远超“理解”,它代表着一种深刻、直观、感同身受的领悟,一种与被理解对象融为一体的境界。

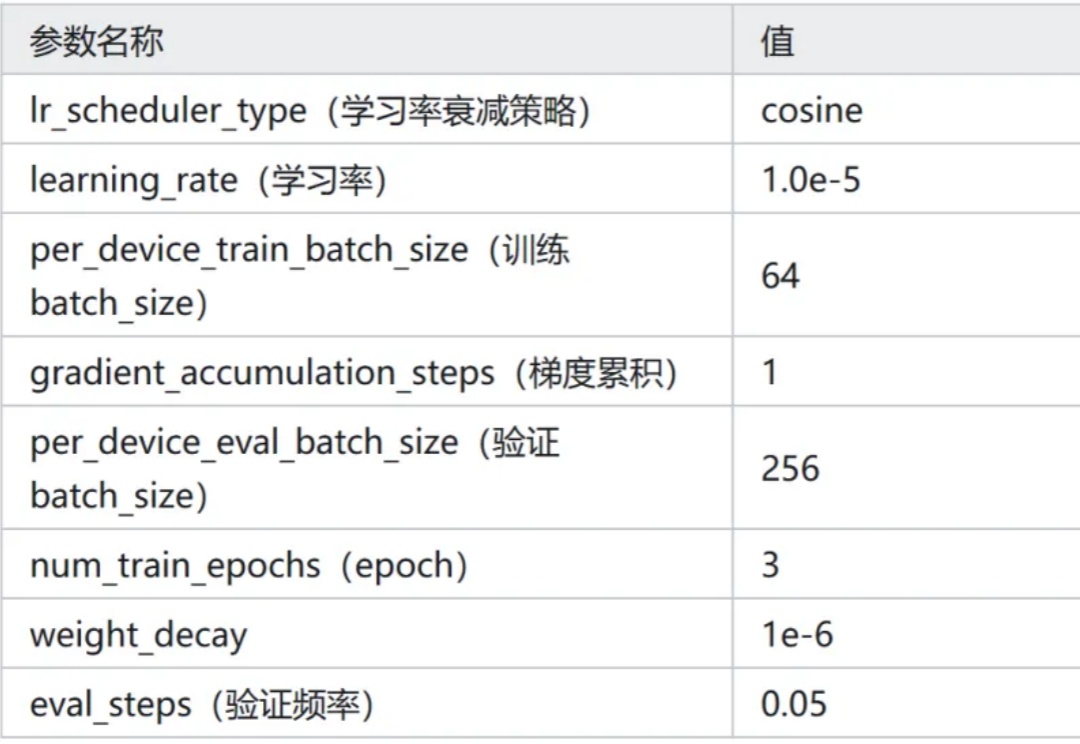

新增 Qwen3-0.6B 在 Ag_news 数据集 Zero-Shot 的效果。新增 Qwen3-0.6B 线性层分类方法的效果。

梵蒂冈宣布,美国红衣主教Robert Prevost正式当选新任教皇。有趣的是,在一次预测中,AI却完全完全漏掉了他!

到了2025年,即便是对科技不太感兴趣的人应该也会对人工智能(AI)如雷贯耳了,AI改变生活也早已不是预言,而是正在发生的现实。既然AI是热点,也就意味着必然有人会试图浑水摸鱼,最近就有美国的投资者因此遭殃。近日美国司法部方面透露,AI购物应用Nate的创始人Albert Saniger被指控通过虚假宣传AI技术,骗取了超过4000万美元的投资。

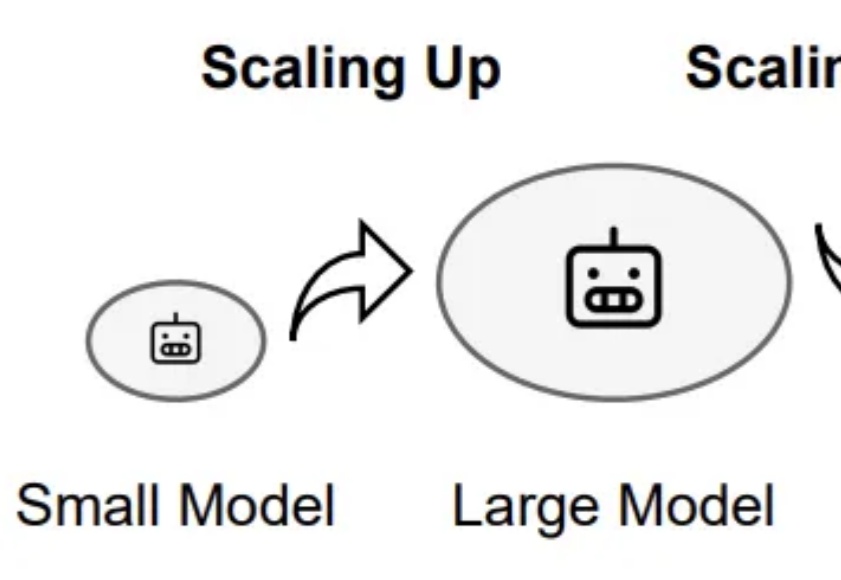

近年来, Scaling Up 指导下的 AI 基础模型取得了多项突破。从早期的 AlexNet、BERT 到如今的 GPT-4,模型规模从数百万参数扩展到数千亿参数,显著提升了 AI 的语言理解和生成等能力。然而,随着模型规模的不断扩大,AI 基础模型的发展也面临瓶颈:高质量数据的获取和处理成本越来越高,单纯依靠 Scaling Up 已难以持续推动 AI 基础模型的进步。

当谷歌在 2018 年推出 BERT 模型时,恐怕没有料到这个 3.4 亿参数的模型会成为自然语言处理领域的奠基之作。

Mamba 这种状态空间模型(SSM)被认为是 Transformer 架构的有力挑战者。近段时间,相关研究成果接连不断。而就在不久前,Mamba 作者 Albert Gu 与 Karan Goel、Chris Ré、Arjun Desai、Brandon Yang 一起共同创立的 Cartesia 获得 2700 万美元种子轮融资。